OculusGoを始めとしたHMDも手に入りやすくなり、Vtuberなども広く認知されてきて、現実世界の身体の動きをVR空間に入力するデバイスが個人利用においても求められてきています。今回は、個人でも手に入れることができるモーションキャプチャーを少し試したのでご紹介します。

そもそもモーションキャプチャーって?

みなさんもCGによる映像作品の制作過程などで、全身タイツで各関節にマーカーを付けた演者を撮影している様子などを見たことがあるのではないでしょうか。

モーションキャプチャーは現実の人物やモノの動きをデジタル化する技術の総称になります。技術的には、先の例に出した「動くモノ」に付けたマーカーを外部から光学的に認識してデジタル化するタイプと、体の各部にセンサーを取り付け、それぞれの動きの相対的な差で動きをデジタル化するタイプに分かれます。

光学的にデジタル化するタイプは、全身がくまなく撮影できるカメラとその空間が必要になり、システム的に大規模になります。価格も数百万から数千万(広さや精度、ソフトウエア機能によって変わります)と大変高価ですが、空間における絶対値で認識でき、見ている状況と同じなので、複数人やモノとの位置関係が重要な時にはピッタリなシステムです。

後者のセンサータイプは必要な空間も小さく、デバイスも高性能・低価格化が進んでいるので手軽ですが、どうしても絶対位置の正確さには欠け、誤差もだんだん蓄積してしまいます。例えば両腕の指先を合わせたりすると、キャプチャーデータでは指先の位置がずれていたりしてしまいます。しかし、動きのセンシングやデータ取得スピードなどは、低価格のモノでも実用的なレベルになってきています。

個人でも手に入るセンサータイプのPERCEPTION NEURON2.0

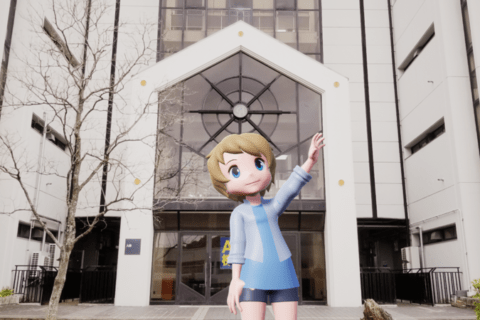

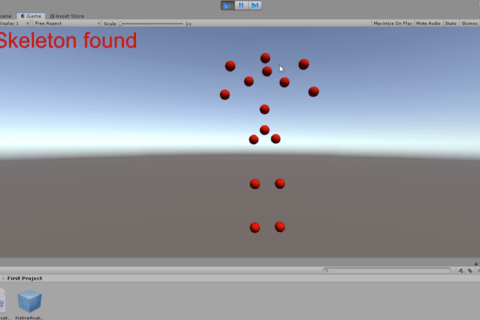

今回取り扱うのは、PERCEPTION NEURON2.0です。下記サイトで実売価格で20万円ちょっと、と十分個人で購入できる範囲ですし、何よりソフトウエア環境なども整備されているので、デバイスの専門知識などなくても身体のモーションキャプチャーをする事ができます。Untiyなどとも連携できるのでそのまま、3Dキャラクターを動かす事も可能です。

先程センサータイプのデメリットを指摘しましたが、位置の補正をして、長時間使わなければ、動き自体を読み取る精度は優れていますし、処理スピードも最大60FPSで表示できる程なので、人間の動きをデジタル化することに問題はありません。

身体の空間における位置の正しさではなくて、動きの緩急や細かな特徴を表現する事にはピッタリですね。

実際の使い方

コンパクトな見た目

このようなツールボックスの中にすべてのパーツが入っています。大変コンパクトです。センサーは各部位ごと袋にまとめられています。

ちょっと事件現場のようですが、装着する部位ごとに並べてみました。

ソフトウエア環境の準備は簡単

ソフトウエアは以下のサイトからデモアプリがダウンロードできるので、まずはこれを試すのが良いかと思います。特にドライバを等を別にインストールする必要はなく、このアプリのみでデバイスを試す事ができます。

インストールすると現れるミケランジェロ 「神のごとき人」風なイラストでちょっと盛り上がる。これから3Dアバターに魂を入れる!

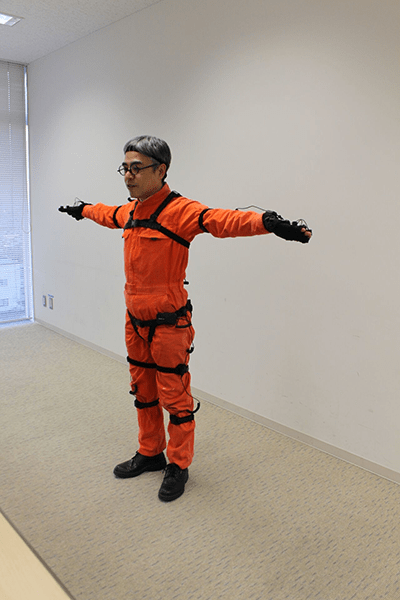

サイバー感あふれる装着感

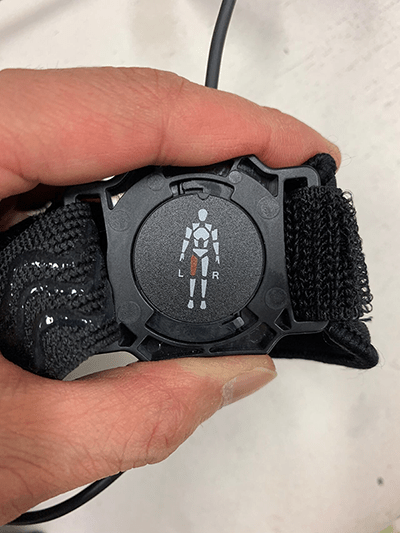

さて、デバイスの装着です。Webのマニュアルでは淡々と装着していますが、初めてだと大変手間取ります。デバイスの裏に、各パーツのイラストがあるので、取付場所で迷うことはないですが、固定方法やマジックテープの処理の仕方などが良くわからないので時間がかかります。最初は2人がかりでも30分程度必要かと思います。

慣れれば1人でも15分くらいで装着できるかと思いますが、かなり場数が必要かと思います。

わかりやすいようつなぎの上から装着してみた

わかりやすいようつなぎの上から装着してみた

デバイスの裏に装着位置が表示してある

デバイスの裏に装着位置が表示してある

キャプチャーの応答速度と細かさは問題ない

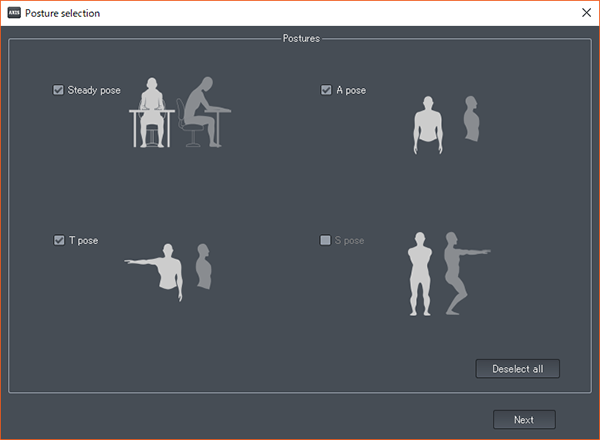

装着が終わったら、キャリブレーションを行います。指定されたポーズをして、3秒位静止します。静止するのがちょっと大変ですが、コツさえ掴めば簡単です。長い間、キャプチャしているとだんだんズレてくるので、動きがおかしいなぁと思ったら、キャリブレーションを再び行うと良いかと思います。

ポーズその1(Steady pose)

ポーズその1(Steady pose)

ポーズその2(A pose)

ポーズその2(A pose)

ポーズその3(T pose)

ポーズその3(T pose)

ポーズその4(S pose)

ポーズその4(S pose)

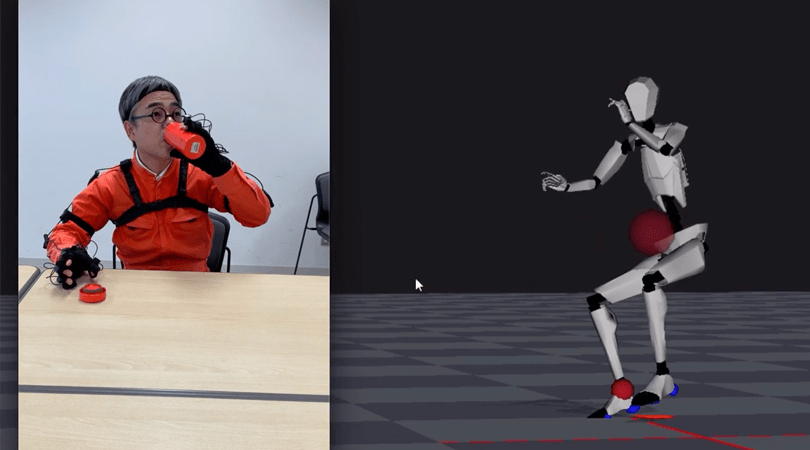

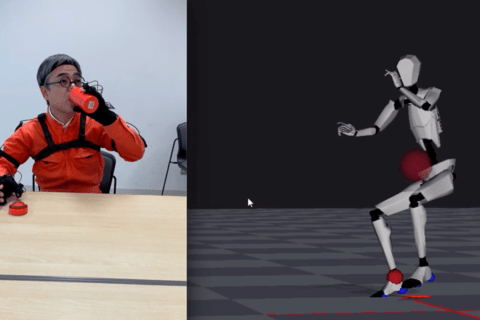

キャリブレーションすれば、モーションキャプチャーのデモが体験できます。反応も良いし、細かな動きも反映するので、初めてモーションキャプチャーする人は感動するかと思います。

細かなところを見ていくと、両腕の先端を合わせたりすると、絶対位置のズレが顕著に分かります。先に説明したとおりセンサータイプは絶対値のズレに弱いですが、体型のデータを反映させるとかなり改善されます。体のパーツごとに細かくチューニングすることもできます、今回は予め用意されている体型のセット(男、身長160)を利用しました。

動画は、最初手を合わせたり自分の腕や頭、顔を触っています。その後、水筒から水を飲んでいます。前半は調整前の絶対位置のズレの参考に、後半は日常の動きの再現性の参考にしてください。

どうでもいいですが、標準の3Dアバターは某SFマンガの敵キャラにそっくりな見た目ですね。

何をデータ化するか?は工夫次第

90年代後半から空間スクリーン(COSMOS)やら、高額な光学式や磁気式のモーションキャプチャーを体験している身からすると20万円程度でこれだけのデータが取得できれば、大変なコストパフォーマンスだとは思います。コンテンツ制作に関わっていないとなかなか個人では購入できないかもしれませんが、ちょっとしたモーションデータを作りたい、とか、パフォーマーや職人的な人の動きのデータを取りたい、といった要望には答えてくれる商品だと思います。3Dのモーションデータは増えてきていますが、特殊な動きや個性を出したい動きがある場合は、これで作ったほうが絶対早いですね。

パソコン工房では映像制作などのクリエイター向けパソコンとしてSENSE∞(センスインフィニティ―)にてBTOパソコンを扱っております。

メーカーエンジニアを経て、独立。普段は、ファブスペースを運営したりモバイルアプリやシステムを作ったり、子供向けワークショップをしたりしています。趣味は分解。

![NEXMAG[ネクスマグ] パソコン工房](/magazine/assets/images/common/logo.svg)